Da Cambridge Analytica al Chinese Social Credit System, la condivisione e la raccolta di dati personali potrebbero diventare una delle più grandi minacce alla democrazia e alle libertà fondamentali.

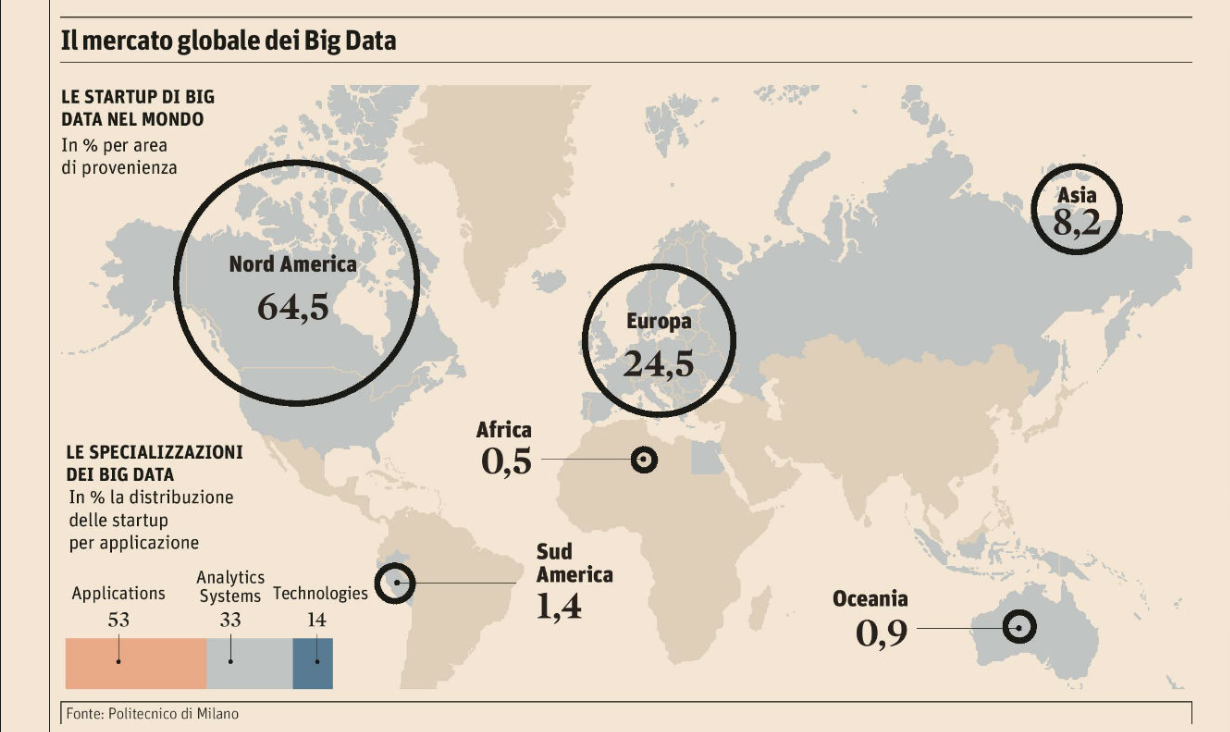

Ormai da alcuni anni i big data – per la cui breve definizione vi rimandiamo a Dataskills – hanno raggiunto un’importanza tale da essere posti tra le merci di maggior valore al mondo.

Non è un caso che le grandi corporation che si occupano di raccolta e gestione di dati abbiano raggiunto valori stratosferici. Imprese come Facebook, Google, Tencent e Amazon valgono sensibilmente di più rispetto, ad esempio, alle grandi conglomerate del petrolio.

A ben pensarci, è un passaggio di consegne abbastanza logico, in un mondo diventato sempre più interconnesso e che si nutre di informazioni.

Quando la maggior parte delle nostre interazioni sociali avviene tramite piattaforme social, quando diventa possibile acquistare qualunque cosa tramite internet senza neppure muoversi da casa, quando persino le questioni più importanti della nostra esistenza possono essere regolate tramite e-mail o sistemi di messaggistica istantanea, diventa facile capire l’importanza delle imprese che ci consentono tutto questo.

Ma le grandi compagnie responsabili di tale incredibile rivoluzione tecnologico-culturale hanno valore non soltanto perché sono diventate ormai indispensabili per la nostra esistenza.

Il vero valore intrinseco di queste compagnie è la quantità di dati che sono in grado di raccogliere. Si tratta dei nostri dati personali, dei quali le imprese di questo settore diventano proprietarie ed utilizzatrici grazie al nostro consenso, espresso in maniera spesso esplicita ma inconsapevole.

Cosa sono dunque i big data?

Si tratta di tutte le informazioni che, più o meno consapevolmente, la maggior parte di noi (per non dire tutti), fornisce quotidianamente tramite le proprie interazioni con i sistemi informatici. Le ricerche che effettuiamo ogni giorno sui vari motori di ricerca, gli acquisti che facciamo, il numero delle nostre carte di credito, i luoghi che frequentiamo, le attività che svolgiamo, i contenuti che pubblichiamo, quelli che ci piacciono e quelli rispetto ai quali siamo critici. Persino le nostre idee ed opinioni politiche.

Ma anche parametri biometrici, come le nostre impronte digitali, il nostro peso, la nostra altezza, le pulsazioni del nostro cuore e il nostro stato di salute. Per arrivare al nostro aspetto fisico, grazie ai sistemi di riconoscimento facciale, sempre più utilizzati anche se ancora poco precisi.

Pechino ad esempio, come racconta questo bel reportage visuale del New York Times, sta utilizzando ed implementando da qualche anno queste tecnologie per rintracciare, controllare e perseguitare la minoranza Uiguri nella provincia dello Xinjiang.

Inoltre, informazioni relative alla produzione industriale, all’andamento dei macchinari, ai trasporti, alla finanza, all’area manageriale, al mondo scientifico. Dati oggi ottenibili facilmente da chiunque e lavorabili in modi del tutto diversi rispetto a 20 anni fa. Tutta questa mole di informazioni fa parte di quelli che chiamiamo big data.

Tramite l’analisi e il collegamento di questa gigantesca quantità di dati è possibile arrivare a prevedere con un certo margine di precisione l’andamento dei mercati, creare profili psicologici superficiali per ognuno di noi, influenzare l’andamento di una consultazione elettorale.

Basti pensare alla burrascosa vicenda di Cambridge Analytica. Prima del fallimento, la compagnia britannica fondata nel 2013 si occupava di processare grandi moli di dati, e tramite un algoritmo poteva creare pubblicità strettamente personalizzate per moltissimi cittadini di diversi paesi.

La compagnia è diventata famosa in tutto il mondo quando alcuni suoi dipendenti hanno denunciato l’uso che Cambridge Analytica faceva dei dati che aveva ottenuto tramite un accordo con Facebook.

Ascolta “#2 – Cambridge Analytica ci ha manipolato?” su Spreaker.

Non si trattava infatti soltanto di marketing. Tra i clienti della compagnia figuravano anche importanti partiti politici o candidati ad elezioni. Tra questi persino il presidente degli Stati Uniti Donald Trump o il leader del partito euro-scettico britannico Ukip, Nigel Farage.

Come ha spiegato Brittany Kaiser, ex dirigente di Cambridge Analytica, la compagnia aveva rilasciato su Facebook un sondaggio che permetteva di fare un profilo psicologico di chi decideva di rispondere alle domande. Accettando di rispondere al questionario, l’utente consentiva all’azienda di avere accesso a moltissimi suoi dati.

E non solo. La compagnia aveva infatti accesso anche a tutti i dati dei contatti e degli amici di colui che aveva partecipato al sondaggio. Ovviamente senza che queste persone ne fossero al corrente o avessero espresso esplicito consenso.

Così facendo, Cambridge Analyitica era riuscita ad ottenere informazioni su milioni e milioni di persone.

Ma come era possibile arrivare ad influenzare l’andamento di un’elezione?

Il meccanismo era abbastanza semplice. Tramite un algoritmo che processava i dati che erano stati raccolti, venivano selezionati gli elettori che noi potremmo definire indecisi: gli swing voters.

Come dice Brittany Kaiser, era assolutamente inutile tentare di far cambiare idea a chi aveva già deciso che non avrebbe votato per Trump o concentrarsi su chi aveva forti convinzioni politiche di stampo Dem.

Grazie ad un sistema di microtargeting venivano creati contenuti personalizzati per ognuno degli swing voters individuati. Il tempismo era fondamentale. Il contenuto doveva essere creato al momento giusto ed in modo tale che instillasse insicurezza o paura nel bersaglio, per poterlo avvicinare progressivamente al candidato presidente per il quale Cambridge Analytica lavorava: Donald Trump.

Non era necessario spostare milioni di voti. Per vincere negli Stati chiave, seppur di poco, era sufficiente influenzare le preferenze di un 1-2% degli elettori. Un numero tutto sommato piccolo. La bravura stava nell’individuare questi pochi elettori in maniera chirurgica.

Appare evidente il pericolo che questo genere di attività comporta per la democrazia, che subirebbe un’ulteriore mutazione.

Ma questi strumenti sembrano essere ancora più pericolosi quando vengono utilizzati da regimi autoritari.

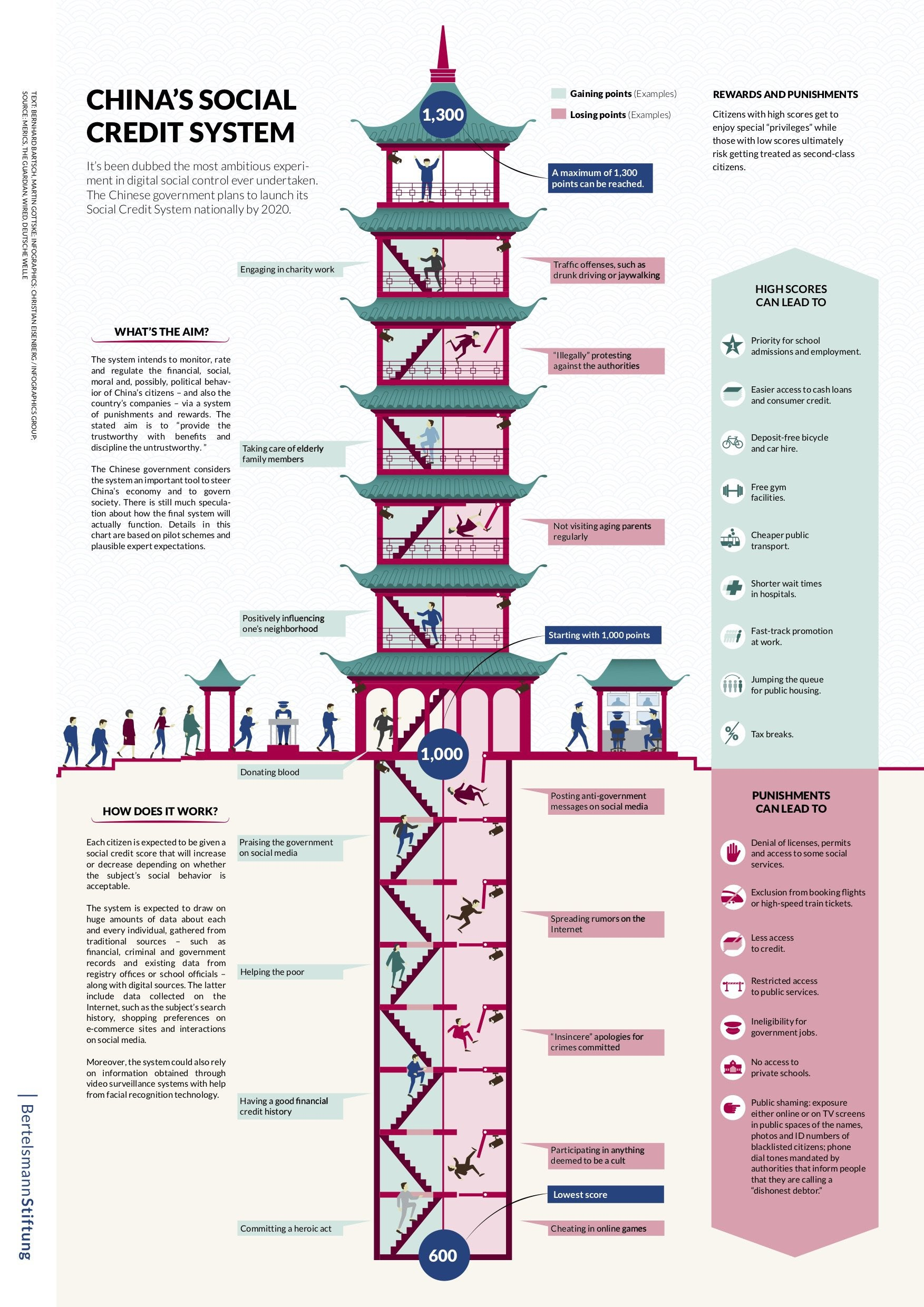

Nel 2014 il governo cinese dichiarò che stava lavorando all’implementazione di un sistema di controllo sociale, noto come Chinese Social Credit System. Esso doveva essere completato entro il 2020 ma le tempistiche non sono state del tutto rispettate.

Il sistema è draconiano, ma l’80% della popolazione cinese sembra essere favorevole alla sua introduzione (per quel che possono valere queste rilevazioni).

Il CSC ha un funzionamento concettualmente semplice da comprendere. Per implementarlo il governo cinese si è appoggiato ai software di Alibaba e Tencent. Si tratta di due compagnie private, ma in Cina il confine tra pubblico e privato è piuttosto labile, soprattutto nel settore tecnologico.

Alibaba è una sorta di Amazon cinese, mentre Tencent è l’impresa proprietaria di WeChat, il più diffuso e versatile social network della Cina.

Entrambe le compagnie hanno sviluppato sistemi di pagamento tramite app: Alipay e WePay. Esse sono talmente diffuse che il contante è quasi totalmente sparito dalla circolazione nei grandi centri urbani cinesi.

Tramite i dati raccolti grazie alla collaborazione con queste importanti imprese, il governo cinese è in grado di fornire ai propri cittadini una valutazione, espressa da un numero compreso tra 350 e 950.

Più alto è il rating, più vieni considerato un buon cittadino. La valutazione dipende da una miriade di variabili come il rispetto delle norme, il pagamento delle multe o dei debiti, il pagamento dei conti, la coerenza delle proprie idee politiche con la linea espressa dal Partito Comunista Cinese ecc.

Più il rating è elevato maggiori sono i bonus. Diventa più semplice ottenere un visto per andare all’estero, acquistare biglietti aerei, ottenere prestiti, iscrivere i figli nelle migliori scuole, trovare un alloggio in affitto. I problemi iniziano a comparire quando il rating scende oltre una certa soglia.

I 13 milioni di cinesi che sono iscritti nella “blacklist” dei cattivi cittadini non possono più acquistare biglietti aerei o dei treni ad alta velocità, non hanno diritto ad alcuno sgravio fiscale, difficilmente possono ottenere un prestito o mandare i figli nelle scuole che preferiscono.

Inoltre i membri della “blacklist” troveranno i loro indirizzi pubblicati su una mappa di WeChat e i loro volti sulla versione cinese di TikTok. Il rating di ciascuno varia poi anche in base al rating dei propri conoscenti. Avere tra le proprie amicizie persone con un credito poco elevato abbassa il proprio.

Questo determina una sorta di controllo sociale che mette forte pressione su chi ha un basso rating, poiché rischia di essere per questo discriminato e di ritrovarsi isolato. I crediti delle varie persone sono dunque,pubblici ed è possibile visionarli su questo sito.

Sembra che il popolo cinese abbia accolto favorevolmente il CSC. Questo è spiegabile se analizziamo i risvolti negativi della “rivoluzione culturale”. La quantità di delazioni, che riguardavano anche amici stretti e addirittura parenti, tipica di quegli anni, ha portato la società cinese ad essere molto diffidente. Anche l’impressionante numero di frodi e truffe che colpiscono costantemente la popolazione della Cina ha determinato un aumento della sfiducia nel prossimo.

Secondo alcuni osservatori però, il sistema del “credito sociale” si sta diffondendo, in forme diverse, anche nel mondo occidentale.

Nel maggio 2019 Uber ha dichiarato che i clienti con feedback negativo non potranno più usufruire del servizio. Allo stesso modo anche Airbnb non permette a coloro che ricevono un certo numero di recensioni negative di poter sfruttare ulteriormente la piattaforma. Certo, qui parliamo di regole interne ad un servizio, e che non coinvolgono il controllo politico. Ma è una derivazione della stessa capacità di gestire ed utilizzare i dati degli utenti per permettere o non permettere determinati servizi.

PatronScan, un software diffuso nel mondo della ristorazione anglosassone, permette ad esempio di mantenere un database temporaneo con i nomi delle persone che hanno creato qualche tipo di problema in altri locali che utilizzano il software. Una volta operato lo scan del documento di un avventore del locale, PatronScan opera un confronto con il database e in caso di riscontro positivo avvisa il gestore del locale, che può decidere di allontanare l’avventore.

Nello Stato di New York, le compagnie assicurative possono utilizzare i big data per la stipula delle polizze. Se, per esempio, risulta dai social network che una persona che ha stipulato un’assicurazione sulla propria vita, tenga dei comportamenti rischiosi per la sua stessa incolumità, il premio assicurativo può essere aumentato.

Si viene così a creare un sistema di controllo parallelo a quello istituzionale, con effetti in alcuni casi problematici, come l’affievolimento della privacy o l’assenza della presunzione di innocenza. Non c’è nessuna possibilità di difendersi dalle decisioni che vengono prese durante la stesura delle regole d’uso dei servizi tech. Non esiste nessuna garanzia che le regole non vengano applicate in maniera arbitraria ed immotivata. Non si ha la possibilità di eleggere un proprio rappresentante che possa cambiare le regole stesse.

I big data sono la risorsa del nuovo millennio. Ma il loro utilizzo perverso sia da parte dei governi che da parte dei privati, il gap tra progresso tecnologico e progresso legislativo e la nostra mancanza di consapevolezza nell’utilizzo della rete, possono generare grandi problemi.

di Riccardo Allegri